Apple kısa süre önce, iPhone’larda yasa dışı malzemeleri aramayı planladığını iddia eden bir raporu doğruladı. Bu, gizlilik korumalarını uzun süredir teşvik eden bir şirketten. Sivil özgürlük gruplarından kınama hızlı geldi, ancak birçoğu Apple’ın amaçlanan hedefi nedeniyle yargılamayı reddetti: çocukların cinsel istismarı görüntüleri. Apple, hükümetlerin bu aracı gözetim amacıyla kullanmasına izin vermeyeceğine dair söz vermek için geri döndü.

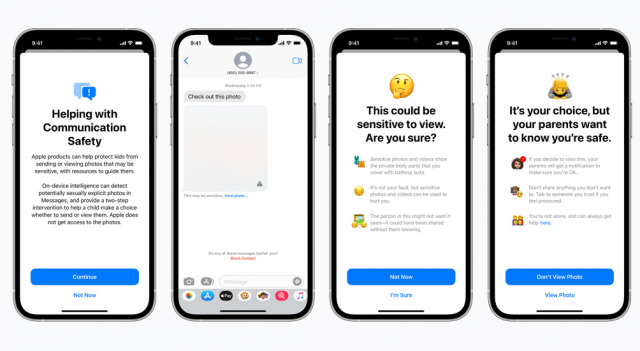

Geçen hafta ayrıntılı olarak açıklandığı gibi, Apple’ın yakında çıkacak olan “Çocuklar için Genişletilmiş Koruma” iki özelliği var. İlk olarak, iOS 15, bilinen Çocuk Cinsel İstismar Malzemesi (CSAM) için cihazlardaki dosyaları tarayabilecektir. Sistem, telefonunuzdaki dosyaların karmalarını oluşturur ve bu dizileri, Ulusal Kayıp ve İstismara Uğramış Çocuklar Merkezi’nden (NCMEC) alınan çocuk istismarı görüntülerinin karmalarıyla karşılaştırır. Bu kontrol, iCloud’a herhangi bir şey yüklenmeden önce tamamlanacak. Madalyonun diğer yüzü, çocuk hesapları için iMessage korumasıdır. iOS, makine öğrenimini kullanarak gelen bir fotoğrafın müstehcen olup olmadığını belirleyebilir. Daha sonra görüntüyü göstermeden önce kullanıcıyı uyarabilir.

Bu hassas bir durum çünkü hem çevrimiçi hem de çevrimdışı birçok şüpheli etkinliği haklı çıkarmak için “biri lütfen çocukları düşünmez mi” ifadesi kullanıldı. Öte yandan Apple, dosya karmalarına dayalı dosyalar için telefonunuzu tarayabilen bir araç oluşturdu ve yalnızca bilinen CSAM’in bir alarmı tetikleyeceğini söylüyor. Bununla birlikte, teorik olarak Apple’ın CSAM olmayan resimleri gözetlemek için karmaları güncellemesini engelleyen hiçbir şey yoktur. Eh, Apple’ın sözünden başka bir şey değil.

En son açıklamasında (PDF), Apple, dosya taramasının aşırı erişim korkusunu yatıştırmaya çalıştı. “Apple’ın CSAM algılama özelliği, yalnızca NCMEC ve diğer çocuk güvenlik gruplarındaki uzmanlar tarafından tanımlanan iCloud Fotoğraflarında depolanan bilinen CSAM görüntülerini algılamak için oluşturulmuştur. Daha önce, kullanıcıların gizliliğini bozan, devlet tarafından zorunlu kılınan değişiklikler oluşturma ve uygulama talepleriyle karşılaştık ve bu talepleri kararlılıkla reddettik. Apple, gelecekte onları reddetmeye devam edeceğiz” dedi.

Apple, eşleşen bir karmanın derhal kolluk kuvvetlerine iletilmeyeceğini de açıkladı. Bunun yerine Apple, hesabı devre dışı bırakmadan ve verileri NCMEC’e iletmeden önce insan doğrulaması yapacak. Ek olarak, aynı CSAM karma kümesi her iOS cihazında yerel olarak depolanacak, bu nedenle birisinin yanlış bir pozitife neden olan bir karma enjekte etmesi “imkansız” olacaktır.

Yine, Apple’ın teknoloji hakkında söylediği şey bu. Apple’a inanma isteğiniz, şirketin geçmiş performansı hakkında ne düşündüğünüze bağlı olacaktır. Apple’ın genellikle yüksek profilli yollarla kolluk kuvvetlerine karşı çıktığını söylemek doğru olur. Ancak, hala para kazanmak için var olan bir şirket ve hükümetlerin, şirketleri tekliflerini yapmaya zorlamak için parasal ve yasal araçları var.